robots协议的作用

引导搜索引擎蜘蛛抓取指定内容或栏目。比如,有的网站部分内容,只有注册会员后,登陆会员功能才能看到更多内容。

网站改版或者URL需要重写优化的时候屏蔽对搜索引擎不友好的链接。

屏蔽死链接、404页面。

屏蔽无内容页面、无价值页面。

屏蔽重复页面,如搜索结果页、评论页面等。

屏蔽任何不想收录页面。

引导蜘蛛抓取网站地图。

当搜索引擎王文网站时,会优先访问网站的robots协议,从中来获取信息来抓取网站。那么如果没有robots协议会对网站有什么影响呢?

如果没有robots,搜索引擎蜘蛛访问网站时依旧会先访问robots.txt,没有的话会返回404页面,影响虽然不大,但是也绝对不好。

没有robots,搜索引擎蜘蛛默认抓取所有内容。这一点影响不是很大,但是还是取决于网站的内容,如果存在很多低质量的内容,建议还是使用robots进行限制比较好。

综合上面所说的内容,robots协议还是加上比较好,没有很麻烦,我们一般会把robots放在FTP的根目录下,有助于蜘蛛的抓取。

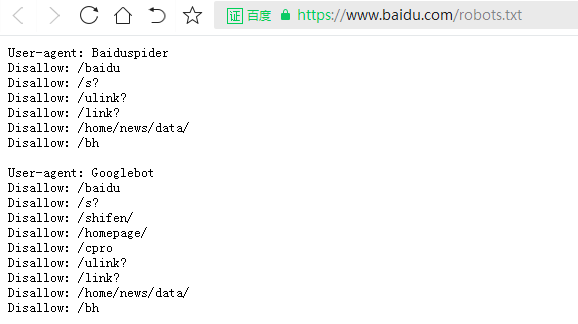

robots协议怎么写

robots的常用的命令一般有:

User-agent:*(这里的*代表的所有的搜索引擎种类,这句话表示可以让所有的搜索引擎都可以访问抓取这个网站。)

Disallow:(这个表示禁止的意思,一些不想让搜索引擎访问的页面可以把路径写下来。)

Allow:(这个表示允许的意思,想要搜索引擎访问页面可以把路径写下来。)

robots.txt文件书写注意事项

英文符号下写。

冒号后要有空格。

首个字母要大写。

/网站根目录(网站所有)。

其实,robots.txt文件,只要熟悉理解代码,书写和应用很简单。